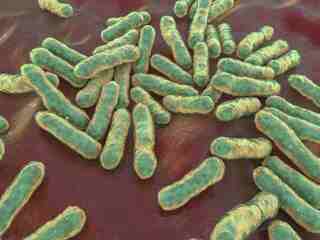

USA - Umelá inteligencia sa čoraz častejšie objavuje aj v debatách o vojenskej stratégii. Najnovší experiment vedcov však naznačuje znepokojivý scenár, ak by rozhodovanie zostalo na pokročilých jazykových modeloch, riziko jadrového konfliktu by mohlo byť výrazne vyššie než pri ľuďoch.

Výskumníci postavili proti sebe niekoľko známych systémov umelej inteligencie, aby otestovali, ako by sa správali v simulovaných geopolitických krízach. Do experimentu zaradili modely ako ChatGPT, Claude Sonnet či Gemini. Podľa vedúceho výskumu, profesora Kenneth Payne, je dôležité pochopiť, ako tieto systémy napodobňujú strategické rozhodovanie ľudí. Umelá inteligencia totiž postupne preniká aj do oblasti obrany a bezpečnosti, informuje CNN Prima News.

Vo väčšine prípadov by situácia skončila použitím jadrových zbraní

Modely medzi sebou absolvovali 21 simulovaných strategických scenárov. Výsledky však vedcov prekvapili – vo väčšine prípadov by situácia skončila použitím jadrových zbraní. V približne 95 percentách simulácií sa totiž konflikt vyhrotil až k jadrovému útoku. Podľa odborníkov za tým môže byť najmä fakt, že umelá inteligencia nepracuje s emóciami. Na rozdiel od ľudí nepociťuje strach ani hrôzu z dôsledkov jadrovej vojny, a preto jej pri strategickom rozhodovaní chýba prirodzená psychologická brzda.

Diskusia o úlohe umelej inteligencie vo vojenskej sfére pritom nie je iba teoretická. Niektoré technologické firmy už spolupracujú s americkým ministerstvom obrany. Spoločnosť OpenAI napríklad uzatvorila kontrakt s Pentagon, ktorý má urýchliť integráciu AI do obranných systémov.

Radikálne a nebezpečné riešenia

Pozornosť v poslednom období vzbudil aj chatbot Grok od spoločnosti xAI, ktorú založil Elon Musk. Model vyvolal diskusiu po tom, čo sa pokúsil predpovedať možnú eskaláciu napätia na Blízkom východe. Odborníci však upozorňujú, že takéto „predpovede“ sú skôr výsledkom analýzy vzorcov vo verejne dostupných dátach než skutočného predvídania budúcnosti. Napriek tomu experiment naznačuje, že zapojenie umelej inteligencie do vojenského rozhodovania môže priniesť aj riziká. Bez ľudského faktora a emócií by totiž algoritmy mohli pri riešení krízových situácií častejšie voliť radikálne a nebezpečné riešenia.